ИИ-6. Страхи и отмазки. Репортаж: Форум по этике ИИ

Всем привет, этичные кожаные мешки!

Придётся обратно же поговорить про ИИ. Это же сейчас самое главное, да вот хоть Грефа спросите.

Я только что побывал, заодно и выступил на Форуме по этике искусственного интеллекта. Очень познавательно.

Форум проходил в Центре мировой торговли на Пресне, он же Хаммеровский центр, в полукилометре от небоскрёбов Москва-Сити. Организован форум уже в третий раз Центром развития ИИ при Правительстве РФ (центр создан в этом году).

Попробуйте угадать, кто генеральный партнёр? А, ну нет, так нечестно, вы знали, знали.

Форум был посвящён Кодексу этики ИИ и разным рискам и проблемам с этикой. Пришло человек двести.

Заставка на экране в главном зале была такая:

Вот эта как бы стеклянная мутная пирамидальная хрень справа, как и псевдодерево на ней — нарисованы, естественно, бредогенератором.

Смысла никакого не несёт, вблизи и точной формы не имеет тоже, то ли лестницы, то ли горки, грани сходятся кое-как, ни туда ни сюда, как на рисунках Эшера. Ну то есть совершенно бессмысленные. Чисто генеративная красотищща. Организаторам это — видимо, ОК. Это вообще показательно.

Наиболее познавательно было пленарное заседание в 10 утра на форуме.

Сначала собирающихся и рассаживающихся участников приветствовал голос с экрана. Он грохочущим баритоном под тревожную музыку наговорил типовые ИИ-глупости, что-то вроде:

Ув. участники! Я — искусственный интеллект! Я приветствую вас на форуме! Вместе мы сделаем наш мир справедливым, безопасным, обеспечим нам всем лучшее будущее.

По оценкам экспертов искусственный интеллект уже используется в 30% предприятий в российской экономике!

Мы все используем искусственный интеллект в повседневной жизни! Мы все доверяем ИИ нашу жизнь!!!

Поэтому безопасность ИИ — это безусловный приоритет!

Поэтому мы в 2021 году создали Кодекс этики ИИ. Его подписали уже 700 организаций! Институты, компании, корпорации и госорганы. Используют этические принципы.

Россия лидирует по числу компаний, подписавших такой кодекс. А ещё планируется кодекс этики ИИ для БРИКС и единая система регулирования ИИ для БРИКС.

При этом, под грохот и тревожную музыку в качестве иллюстрации на экране крутилось какое-то вибрирующее и содрогающееся светящееся влагалище (или анус, хрен его знает).

Не знаю, что это должно было олицетворять собою. Там ещё написано «вот здесь собрались лучшие специалисты и лидеры индустрии». Где? Вот в этом вот?

Организаторы, наверно, знают. Или надо спросить генерального спонсора.

Текст «титров» — конечно, по-английски — международный же форум.

Дальше на кафедру модератора встал организатор форума — Сергей Наквасин, Директор Национального центра развития ИИ при Правительстве РФ. Кратко — НЦРИИ ПРФ. Скороговорка не хуже других.

Ниже кратко — тезисы выступающих.

Сергей Наквасин:

Почему важно обсуждать вопросы этики ИИ.

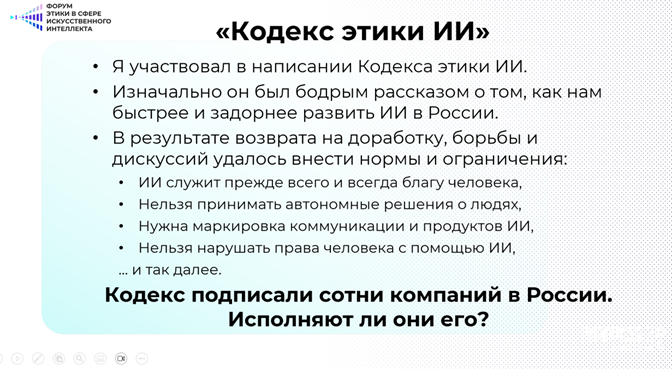

Кодекс был написан в сентябре 2021. Мы собрались большим экспертным сообществом и в дискуссиях написали Кодекс. В октябре 2021 мы провели первый Форум Этики ИИ.

20 организаций присоединились, первые 20 пилигримов! Они подписали Кодекс и стали применять его принципы в своей работе.

Сейчас Кодекс подписали уже более 800 компаний и организаций из 10 отраслей экономики. Наша цель — человекоцентричный ИИ во всём мире. У нас еженедельно собирается комиссия по этике ИИ. Она разбирает сложные вопросы и вырабатывает рекомендации.

Форум сегодня — это транзит от того фундамента, заложенного три года назад, к зданию новой экономики, построенной на ИИ.

Послушаем же наших гостей.

На сцену вышли Татьяна Матвеева (управление ИКТ АП), Валерий Фадеев (СПЧ), Мария Захарова (МИД), Андрей Белевцев (Сбербанк), иностранцы Джассим Хаджи (Президент общества ИИ Бахрейна, а также президент международной группы по ИИ — не знаю, что это значит), Эстела Аранья (советник президента Бразилии по ИИ).

Два запасных докладчика сидели в зале: Саша Крайнов из Яндекса, Андрей Незнамов из Сбербанка.

Татьяна Матвеева (начальник Управления АП по развитию ИКТ и инфраструктуры). Этика в ИИ открывает новые возможности для общества и разработчиков. Этика — это ключевой элемент доверия. Примерно 80% граждан по опросам ВЦИОМ — за этичные правила и за проверку человеком. Их понять можно.

Но надо также повышать ответственность пользователей при пользовании такой сложной и хрупкой технологией. Не только разработчиков!

Но в любом случае пора переходить к сертификации. Нужны нормы, стандарты, принципы. Нужны организации, выдающие сертификаты этичности.

А ещё нужны образовательные программы в вузах про этику ИИ.Такое уже есть в Питерском Универе.

Комиссия по этике Альянса ИИ уже сделала «Белую книгу» по этике ИИ, там разобраны кейсы. Для студентов, разработчиков. Это первая такая книга в мире! Мы скоро её представим на Форуме ИИ в октябре.

Этика становится инструментом «мягкого права», в том числе международного, в БРИКС это один из приоритетов. Вчера встречались министры БРИКС по ИКТ — они выступают за инклюзивный, ответственный, этичный ИИ, преодоление цифрового разрыва, улучшение жизни людей.

Наквасин:

Передадим слово Марии Захаровой. Сейчас идёт гонка в мире за технологическое лидерство, она не всегда этичная. Мы адаптируемся к этой гонке, умные камеры, генеративные модели, БПЛА, но в любом случае мы лидер в этике! Нигде нет такого форума, регулярного, постоянно действующего. Итак, что думает об этом МИД?

Мария Захарова (МИД). Я бы сказала, что происходит «революционная эволюция»! В международном праве. Оно адаптируется, эволюционно, но очень быстро. Государства — на разных стадиях применения и оформления. Кто теоретически изучает вопрос, а кто уже вовсю применяет.

При этом идёт неспортивная соревновательность, не вполне бои без правил, правила какие-то есть — но они грубо попираются. Мировое сообщество вроде занялось регуляторикой, соглашениями.

Но разработка норм и принятие решений будут подвержены воздействию по западным образцам, будет силовое соперничество вне правового поля.

МИД РФ делает всё, чтобы вернуть международное взаимодействие в правовое поле — чтобы тема ИИ тяготела к сотрудничеству, как другие темы. В соперничестве и конкуренции плохого нет. Но пока всё сваливается в борьбу и агрессию.

Только что принята первая резолюция ООН, целиком посвящённая ИИ. Вторая сессия — про международное сотрудничество в области ИИ.

Прошёл Саммит будущего в Нью-Йорке Результат пока неоднозначный, но подписан Международный Цифровой договор.

Такие же процессы идут в БРИКС и в СНГ (вчера опубликовано заявление от лидеров СНГ — подписано соглашение об гражданском ИИ, первый такой документ на пространстве СНГ).

Были разные представления, противоречивые подходы, но в итоге есть соглашение. Там есть этика нейросетей, регулирование и саморегулирование ИИ, есть прямое указание на Кодекс Этики. Церемония подписания некоторыми участниками будет здесь же, позже.

Да, можно бояться, что ИТ-гиганты отодвинут этику на второй план. Надеемся, что этого не произойдёт, темпы развития стимулируют дискуссии.

Вот недавно мы посещали офис нашего флагмана ИИ, смотрели разработанное ПО. Они предлагали свои продукты МИДу. В том числе генерацию голоса спикера, где всё идеальное — тональность, тембр, интонация и эмоции. Это нужно, чтобы заменять уставших от публичной жизни спикеров. Вот, например, у меня уже садится голос!

Но это ведь прямая дорога к дипфейкам! Как только мы покажем всем, что так можно — озвучивать позицию, смыслы автоматически, все бросятся так делать в политической сфере. Что же делать? Казнить нельзя помиловать. Надо понять, где поставить запятую. Технологий-то много, но где применять и как? Какие антидоты вырабатывать?

Этим должны заниматься те, кто вырабатывает этику. Коллеги — молодцы! Наш российский вклад в этику ИИ — уникален. Нужно насыщать технологии ИИ-этикой, плечом к плечу с практиками, учёными. Сохранить этическую политику и повестку.

Наквасин. Важно вырабатывать доверие общества к технологиям. При создании Кодекса в 2021 было столкновение математиков, романтиков ИИ (за мягкое регулирование), и представителей общественности (чтобы не было как в фильме «Терминатор», не допустить катастрофического сценария). Но грамотность населения в области ИИ возросла, мы теперь понимаем и риски, и возможности.

Попросим советника Президента и главу СПЧ Фадеева.

Валерий Фадеев (советник Президента, глава Совета по развитию гражданского общества и правам человека): спасибо за вопрос, СПЧ интересуется темой ИТ шире, цифровизацией вообще, мы разрабатываем концепции, регулярно докладываем Президенту.

Мы сейчас отстаём от реалий очень сильно. Кодекс этики — хорошо. Но всё равно сильно отстаём от реальной жизни.

Вот смотрите. По данным МВД, за год в России было суммарно 48 тысяч краж, квартирных и уличных. И при этом — 1 600 000 списаний денег мошенниками, то есть в 34 раза больше киберпреступлений. Кражи в реальном мире составляют 3%.

Сбербанк прогнозирует, что будет украдено у граждан 300 миллиардов в 2024.

Ну, можно сказать, это же плата за прогресс? Тогда нужно спросить: а что тогда прогресс?

Вот возьмём систему FacePay в московском метро. За три года в системе зарегистрировалось примерно триста тысяч москвичей. Из 15 млн пользующихся метро, то есть 2%. Это что, прогресс?

А вот само метро, когда его прокопали, электричество, провода, динамо-машины, электропоезда, эскалаторы, пробиватели туннелей. Это был реальный технологический прорыв. Вот это — прогресс. Реально меняющий жизнь.

И вдруг вы говорите, что это всё ерунда, а вершина прогресса — платить лицом. Для 2%. Это же комично.

Ну и вот теперь прогресс — это генеративные нейронные сети. Они якобы могут писать тексты за журналистов? А зачем? Доливать ручейки шлака в общий септик Интернета?

Говорят, давайте искусственный интеллект будет писать тексты за журналистов. А зачем? Это же чушь. Журналист — это профессия. Если начинающие журналисты не будут писать простые тексты, то они никогда не станут опытными журналистами. Ниагары информационного мусора в Интернете, теперь давайте ещё ИИ будет дополнять их своими ручьями.

Базовая функция журналиста — поехать туда, где произошло событие, поговорить с людьми, понять смысл произошедшего, хорошим языком это изложить. ИИ не может же поехать на место событий, опросить участников, очевидцев, и т. п.

Мы на протяжении 24 лет читаем репортажи Андрея Колесникова из президентского пула в «Коммерсанте» о событиях, связанных с Президентом России. Колесникова можно заменить искусственным интеллектом? Вы готовы читать вместо него новости ЧатЖПТ? Это смешно!

Или вот «Кандинский» и прочие. Рисуют картинки. Ну это же гламурная пошлятина. Потому что в интернетах — массовая гламурная пошлятина.

ИИ нужен где? Промышленность, война. Вот там — пожалуйста. Эти задачи не несут социальных рисков. Здесь можно.

А зачем с ИИ вторгаться в социум? Неприкосновенность частной жизни записана в вашем Кодексе, а до этого — в Конституции. Я лично считаю, что должен быть запрет на автономные решения ИИ. И полный запрет вмешательства в частную жизнь.

Собраны гигантские массивы данных про каждого из нас. Безусловно, для того, чтобы манипулировать. Моя точка зрения, она вам покажется мракобесной, очень простая: запретить вообще индивидуальный контакт с человеком в области торговли с использованием персональных данных.

Сплошь и рядом звонят: «Иван Петрович, мы знаем, что вы интересуетесь китайскими машинами, мы хотим предложить вам скидку». Такой звонок должен рассматриваться как мошенничество, и по его поводу должно возбуждаться уголовное дело. Это вмешательство в личную жизнь человека.

Вообще это создание прозрачности — опасная манипуляция людьми, природой человека. Прошло уже 15 лет с того времени когда Цукерберг и Брин (Цукербрин по Пелевину), выступили с декларацией «тайны частной жизни больше нет».

Что, поверим Цукербринам? Частная жизнь — это одна из основ человека. Отмена её — это глубокие антропологические изменения. Неизвестные. Которые изменят человека неизвестным нам образом.

Мы что — готовы отменить эту статью в Конституции?

У нас нет осознания этих изменений, нет базовой философии. Мы не знаем, к каким это последствиям приведёт, если не будет частной жизни. Пока мы этого не осознали — я выступаю на стороне Конституции.

Да, Кодекс этики ИИ — это важно. Вы в этом лидеры, как сказала Захарова. Хорошо.

Но дальше нужно переводить этические правила в правовые. Нежно, аккуратно, но в конечном счёте — в законы. Совет по правам человека готов в этом помочь.

Наквасин. Приглашаю Андрея Белевцева. В 2020 году Андрей поддержал создание Кодекса от экспертной группы. Сейчас он представитель Сбербанка. Один из самых технологических банков мира! Как вы применяете этику в технологиях, чем это вам помогает?

Андрей Белевцев (глава разработки ИИ в Сбербанке): Любая технология меняет жизнь. Можно применять в добро и во зло. По миру распространяется выражение AI in for good! ИИ для добра! Мы за это.

Генеративные модели — это революция. 12 миллионов пользователей используют сервис «Кандинский», 22 миллиона — Гигачат. Сгенерировано уже 200 миллионов картинок. Почему люди делают это? Им это нужно!

Но да, мошенники всегда на шаг впереди. Они ищут по миру технологии, инструменты для мошенничества. А технологий, инструментов в мире — много.

Но это — ответственность исключительно мошенников. Кто-то произвёл фомку, а кто-то вскрыл квартиру или машину. Фомка и её производитель ни в чём не виноваты!

Но саморегулирование нужно! Мы в Альянсе подписали Декларацию об ответственной разработке генеративного ИИ. На сайте Альянса ИИ можно почитать. Присоединяйтесь. Так мы сделаем наш мир безопаснее.

Польза ИИ драматически перевешивает риски! Генеративные модели — это первые шаги. А если применять в медицине! Для анализа всего, что есть о больном — анализов, анамнеза, снимков!

А генерация лекарств. Они же будут дешевле! Почему лекарства дорогие? Очень дорог анализ молекул новых лекарств, а также испытания. ИИ даёт сокращение времени на испытания и анализ свойств молекул иногда с нескольких лет до нескольких дней! Значит, цены будут ниже для больных людей!

Про принятие решений. У кого из вас есть автомобильные права? Ну вот, у половины. Вы же понимаете, что последние 15 лет сам автомобиль принимает решение, тормозить или нет. ABS и всё такое!

(Крики из зала: «Это неверно!»).

Ближайшие перспективы — агенты и … пока не переведено на русский … овеществление ИИ! (просто пересказывает Шмидта про agents и text to action). Их нужно испытывать, сертифицировать!

ИИ — это огромный толчок для экономики. Эксперты оценивают, что в ближайшие годы ИИ даст плюс 3% к мировому ВВП — это от генеративного ИИ. Это больше ВВП России!

Про требование маркировки. Вот мы скоро выложим распознаватель искусственных текстов и человеческих. Надо помогать людям отличать.

Надо, конечно, маркировать. Хотя, фотки на вашей мобиле всегда применяют фильтры ИИ. Они всегда срабатывают, если специально не отключить. Красотища же! Вы же не отказываетесь!

Нужно, чтобы плюсы превышали риски. Для этого риски надо закладывать на этапе проектирования.

Фадеев: зачем нужно нагенерить текст, а затем его отличать от настоящего? Это же как крабовый салат и салат из «крабовых палочек», разница в пять раз по цене. И по вкусу.

Белевцев: Есть же разные сценарии! Ну вот можно же поручить подготовить выступление или совещание! Больше идей для мозгового штурма.

Фадеев: тогда это интеллектуальный поисковик, а не самостоятельно плавающий текст. Промежуточные инструменты.

Захарова: нужно кодифицировать маркировку текстов ИИ. Везде, со ссылкой — студент, доцент, учёный, диплом, кандидатская, монография, художественный текст — везде сноска, что сделано ИИ. Оформить это законодательно. И вот тут же заработает такая саморегуляция — залюбуешься. Граждане сами будут решать, хотят ли они читать искусственное.

Сейчас регуляции нет. Будут массово выпускаться искусственные учебники, пособия для несовершеннолетних. Сначала на равных с настоящими текстами. Но потом они начнут заполнять пространство настолько, что сами станут базой для следующего этапа обучения ИИ, для принятия решений и использования для учебников. Отличить уже будет нельзя.

Нужно вводить сноску везде — в том числе в рекламу.

Наквасин: пригласим Александра Крайнова, он евангелист ИИ. Вот вчера Нобеля дали как бы по физике, но за ИИ. Расскажите.

Крайнов: кратко про нобелевскую историю: вообще комьюнити в шоке. Взяты два достойных человека, из немногих в сообществе ИИ, но не самые главные гении. Но они точно не имеют отношения к физике.

Нобелевских премий за математику или информатику — нет. Ну вот дали за физику. При этом наградили за то, что сделано вообще в 80-е годы. Ну, что получилось, то получилось.

К этике. Надо сказать, что ИИ — это сквозные технологии, как электричество, как персональные компьютеры и Интернет. Сначала на них только печатали и играли в игрушки. Потом начали работать. Такие вещи незаметно улучшают эффективность, постепенно, повседневно.

Да, генеративный ИИ — пока игрушка. Потом доползёт до медицины, науки, поможет изучать работы предшественников, сделать своё. Будет бустом для всех!

ИИ — всегда вероятностный. Он не даёт 100% качества. Разработчик не может исправить ошибки. Он может сделать так, что следующая версия будет лучше. Монетка же не падает одинаково, даже если две одинаковые стороны. Нет гарантий. Ответ у ИИ — всегда разный. Можно постоянно замерять качество.

Так что нужно иметь чёткие цели и измерения. Нужно вычислять стоимость ошибки. Больше ли ошибка без ИИ или меньше?

Вопросы, на которые не отвечали: вот, допустим, надо взять за образец для ИИ самого этичного человека! На планете! Где он?

Из зала:

Ашманов: Иисус Христос чем тебя не устраивает?

Крайнов: А, ну, устраивает. Но это же в рамках одной религии!

Ашманов: Ну возьми Мохаммеда для мусульман.

В общем, если работать по инструкции, человек или ИИ — всё равно будут люфты, непредвиденные ситуации. Никакая инструкция не даёт 100% исполнения. Этика нужна при любой инструкции!

Дальше были выступления иностранцев. Там всё было совершенно дежурное. Просто рассказ «а вот у нас».

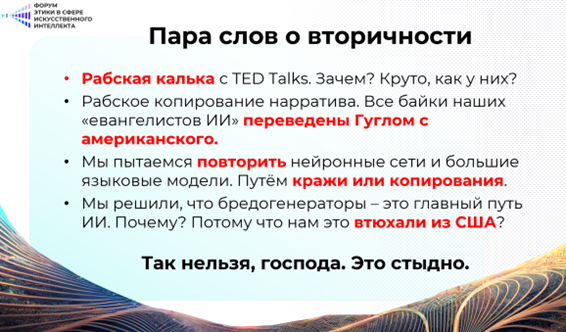

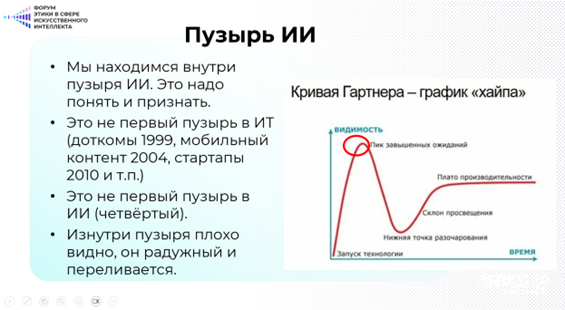

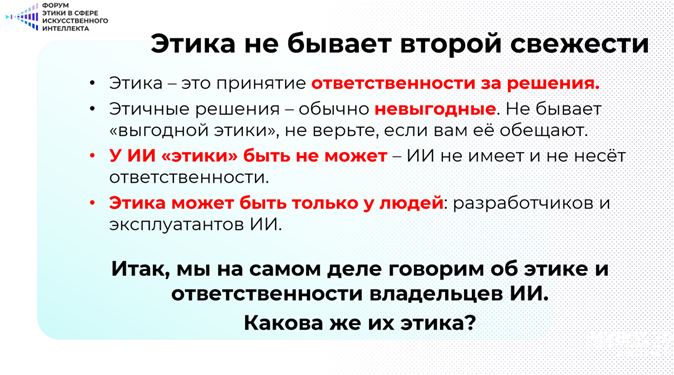

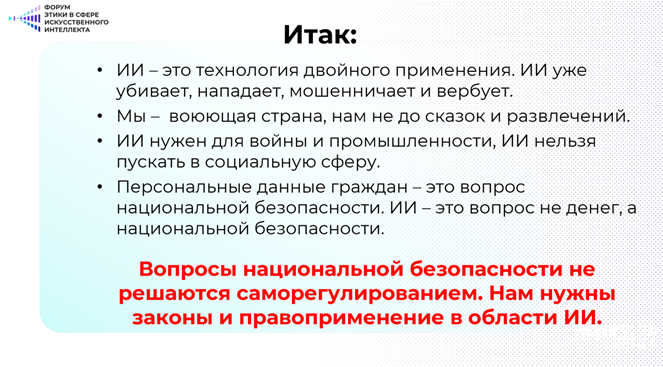

Потом, после перерыва, начались выступления «в стиле TED». 7 минут, 7 слайдов. Я в свою очередь выступил, ниже моя презентация из семи слайдов:

В общем, всё предсказуемо, 80% чистой рекламы ИИ и цифровизации (и это на форуме «про этику») — ИИ это инновационно, полезно, «буст экономики», людям нужно, но они пока не понимают, давайте их обучать, возложим на них ответственность, а не только на разработчиков, надо вообще «стирать грань между человеком и ИИ» (точная цитата из одного из семиминутных выступлений).

Камлания типа «всё равно уже всё открыто», «мы уже отдали все свои медицинские данные». Ну и тому подобное.

А скоро будет AI Jorney от Грефа. Там вообще будет безумие.