- Подпишитесь, чтобы читать далее

Читатель

Читатель Помимо этих отличий, ollama имеет два крутейших отличия от LM Studio, ради которых я и решил рассказать про эти инструменты:

1. Continuous batching (непрерывный батчинг)

Это возможность использовать запущенную модель несколькими пользователями асинхронно. И под пользователями подразумеваются не люди, но и приложения, агенты. Т.е каждый из них может передать модели свой запрос в любой момент времени не дожидаясь окончания работы модели над предыдущим запросом и модель сразу же примется за исполнение этого нового запроса, не прекращая работы над предыдущим запросом.

При этом на скорости исполнения запросов эта настройка влияет весьма слабо, если у вас достаточно памяти. А вот расход памяти будет расти линейно (читайте документациюdocs.ollama.com/faq#how-does-ollama-handle-concurrent-requests). За включение этой функции отвечает настройка сервера OLLAMA_NUM_PARALLEL указывающая, сколько одновременных запросов может обрабатывать ваш сервер

2. Ollama cloud (облако LLM ollama)

Несмотря на то, что на сайте ollama эта функция преподносится как «вы запускаете модель в облаке», по факту они просто предоставляют вам бесплатный доступ к собственной платформе облачного инференса. Т.е вы можете использовать запущенные на их серверах полноразмерные модели вроде GLM-5.1, Qwen-3.6 и даже Kimi-K2.7, расчитанные на запуск на самых дорогих серверных ускорителях и содержащие до 1 трлн параметров.

Хоть эта функция и платная, но для пользователей предоставляется неплохой бесплатный лимит, которого вполне может хватить для ознакомления с моделями и даже для создания небольшого полноценного приложения. Главное, разумно подходить к постановке задач, менедменду контекста и не скатываться в вайбкодинг =)

Помимо этих отличий, ollama имеет два крутейших отличия от LM Studio, ради которых я и решил рассказать про эти инструменты:

1. Continuous batching (непрерывный батчинг)

Это возможность использовать запущенную модель несколькими пользователями асинхронно. И под пользователями подразумеваются не люди, но и приложения, агенты. Т.е каждый из них может передать модели свой запрос в любой момент времени не дожидаясь окончания работы модели над предыдущим запросом и модель сразу же примется за исполнение этого нового запроса, не прекращая работы над предыдущим запросом.

При этом на скорости исполнения запросов эта настройка влияет весьма слабо, если у вас достаточно памяти. А вот расход памяти будет расти линейно (читайте документациюdocs.ollama.com/faq#how-does-ollama-handle-concurrent-requests). За включение этой функции отвечает настройка сервера OLLAMA_NUM_PARALLEL указывающая, сколько одновременных запросов может обрабатывать ваш сервер

2. Ollama cloud (облако LLM ollama)

Несмотря на то, что на сайте ollama эта функция преподносится как «вы запускаете модель в облаке», по факту они просто предоставляют вам бесплатный доступ к собственной платформе облачного инференса. Т.е вы можете использовать запущенные на их серверах полноразмерные модели вроде GLM-5.1, Qwen-3.6 и даже Kimi-K2.7, расчитанные на запуск на самых дорогих серверных ускорителях и содержащие до 1 трлн параметров.

Хоть эта функция и платная, но для пользователей предоставляется неплохой бесплатный лимит, которого вполне может хватить для ознакомления с моделями и даже для создания небольшого полноценного приложения. Главное, разумно подходить к постановке задач, менедменду контекста и не скатываться в вайбкодинг =)

БесплатныйMCP протокол позволяет предоставить LLM возможность контактировать с внешним миром. На практике это буквально упрощение программных интерфейсов, чтобы ими можно было управлять короткими текстовыми командами с соблюдением простых правил.

Что это даёт пользователям? В видео можно увидеть, как запущенная локально LLM открывает браузер и ходит по сайту в поисках ответа на вопрос пользователя, ищет товары во ВкусВилле по расплывчатому описанию и составляет план разработки плагина, опираясь на незнакомую ей документацию. Все эти функции было бы невозможно выполнить без инструментов, предоставляемых для LLM по протоколу MCP в виде легко подключаемых расширений

MCP сайт: modelcontextprotocol.io/docs/getting-started/intro

MCP официальный каталог: registry.modelcontextprotocol.io

MCP от Google: github.com/google/mcp

MCP от NeuralDeep: neuraldeep.ru/mcp

Примеры реализации простых MCP серверов: github.com/modelcontextprotocol/servers/tree/main/src

MCP протокол позволяет предоставить LLM возможность контактировать с внешним миром. На практике это буквально упрощение программных интерфейсов, чтобы ими можно было управлять короткими текстовыми командами с соблюдением простых правил.

Что это даёт пользователям? В видео можно увидеть, как запущенная локально LLM открывает браузер и ходит по сайту в поисках ответа на вопрос пользователя, ищет товары во ВкусВилле по расплывчатому описанию и составляет план разработки плагина, опираясь на незнакомую ей документацию. Все эти функции было бы невозможно выполнить без инструментов, предоставляемых для LLM по протоколу MCP в виде легко подключаемых расширений

MCP сайт: modelcontextprotocol.io/docs/getting-started/intro

MCP официальный каталог: registry.modelcontextprotocol.io

MCP от Google: github.com/google/mcp

MCP от NeuralDeep: neuraldeep.ru/mcp

Примеры реализации простых MCP серверов: github.com/modelcontextprotocol/servers/tree/main/src

БесплатныйДеньги, которые вы мне закидываете уходят обратно на канал. Прикупил себе девайс для ускорения монтажа и книжки по теме. Надеюсь, что это позитивно скажется на скорости производства и на общем качестве

Деньги, которые вы мне закидываете уходят обратно на канал. Прикупил себе девайс для ускорения монтажа и книжки по теме. Надеюсь, что это позитивно скажется на скорости производства и на общем качестве

БесплатныйПолноценной заменой того же Perplexity такая связка, конечно же, не будет. Но отработать какие-то интеграции или tools при выборе модели, подходящей к вашим задачам, данный инструмент определенно может помочь.

LM Studio документация по плагинам: lmstudio.ai/docs/typescript/plugins

LM Studio hub. Страница lmstudio: lmstudio.ai/lmstudio

Плагины в lm studio hub:

- duck-duck-go: lmstudio.ai/vadimfedenko/duck-duck-go-reworked

- visit-website: lmstudio.ai/vadimfedenko/visit-website-reworked

- big-rag: lmstudio.ai/mindstudio/big-rag

Поисковик DuckDuckGo: duckduckgo.com

Полноценной заменой того же Perplexity такая связка, конечно же, не будет. Но отработать какие-то интеграции или tools при выборе модели, подходящей к вашим задачам, данный инструмент определенно может помочь.

LM Studio документация по плагинам: lmstudio.ai/docs/typescript/plugins

LM Studio hub. Страница lmstudio: lmstudio.ai/lmstudio

Плагины в lm studio hub:

- duck-duck-go: lmstudio.ai/vadimfedenko/duck-duck-go-reworked

- visit-website: lmstudio.ai/vadimfedenko/visit-website-reworked

- big-rag: lmstudio.ai/mindstudio/big-rag

Поисковик DuckDuckGo: duckduckgo.com

БесплатныйНастал тот момент, когда маленькие LLM уже могут соревноваться с полноразмерными платными моделями полутора-двухлетней давности. Казалось бы, в то время все LLM были тупенькими и странными. Но если вспомнить, что первый релиз того же Cursor был 23 января 2023 и он сразу же показал себя полезным и привлёк внимание многих разработчиков, то начинаешь понимать, что некоторые преимущества эти малыши всё-таки могут дать.

В этом ролике я рассказал, как быстро и просто запустить небольшую модель, способную работать на вашем компьютере. А также показал, что эта небольшая модель может решать реальные задачи, которые не просто «выведи приветствие в консоль». Да, не без нюансов, но это уже вполне рабочий инструмент. Особенно, если у вас есть достаточно бодрая видеокарта =)

LM Studio: lmstudio.ai

Cline: cline.bot/LM

Настал тот момент, когда маленькие LLM уже могут соревноваться с полноразмерными платными моделями полутора-двухлетней давности. Казалось бы, в то время все LLM были тупенькими и странными. Но если вспомнить, что первый релиз того же Cursor был 23 января 2023 и он сразу же показал себя полезным и привлёк внимание многих разработчиков, то начинаешь понимать, что некоторые преимущества эти малыши всё-таки могут дать.

В этом ролике я рассказал, как быстро и просто запустить небольшую модель, способную работать на вашем компьютере. А также показал, что эта небольшая модель может решать реальные задачи, которые не просто «выведи приветствие в консоль». Да, не без нюансов, но это уже вполне рабочий инструмент. Особенно, если у вас есть достаточно бодрая видеокарта =)

LM Studio: lmstudio.ai

Cline: cline.bot/LM

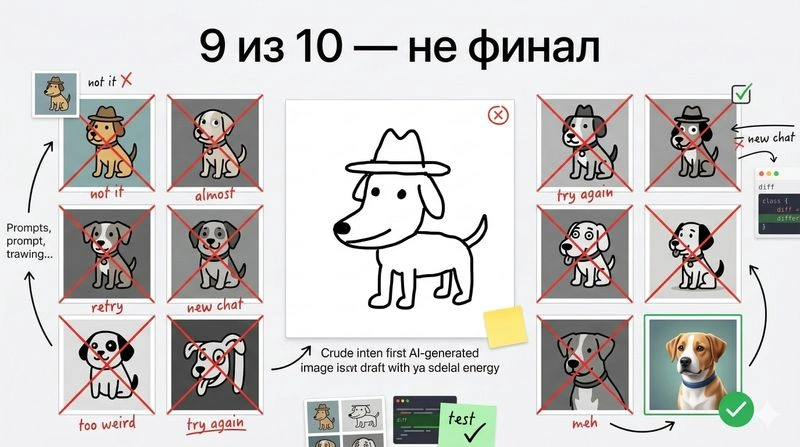

БесплатныйС 2025 года в сети много обсуждений ИИ помощников написания кода. Куча инструментов, куча советов. Все знают термин «вайб код». Но мало кто может внятно объяснить в чём его отличие от «не вайб кода». Кстати, я тоже не могу, но попытаюсь рассказать свою точку зрения на этот вопрос.

Ко мне в личку ворвалось несколько человек из чата с одним и тем же вопросом: хочу поробовать писать код с ИИ, как начать? Этот канал начинался с вопроса «как использовать git?», так что и возродить его можно с другого актуального вопроса.

* Как писать код с ИИ/ЛЛМ?

* С какого инструмента начать?

* Что стоить делать и чего делать не стоит?

* Можно ли писать код с ИИ/ЛЛМ без VPN? (да)

* Можно ли купить подписку за рубли? (да)

С 2025 года в сети много обсуждений ИИ помощников написания кода. Куча инструментов, куча советов. Все знают термин «вайб код». Но мало кто может внятно объяснить в чём его отличие от «не вайб кода». Кстати, я тоже не могу, но попытаюсь рассказать свою точку зрения на этот вопрос.

Ко мне в личку ворвалось несколько человек из чата с одним и тем же вопросом: хочу поробовать писать код с ИИ, как начать? Этот канал начинался с вопроса «как использовать git?», так что и возродить его можно с другого актуального вопроса.

* Как писать код с ИИ/ЛЛМ?

* С какого инструмента начать?

* Что стоить делать и чего делать не стоит?

* Можно ли писать код с ИИ/ЛЛМ без VPN? (да)

* Можно ли купить подписку за рубли? (да)

Бесплатный